辟谣!关于AI换脸诈骗

近期

AI换脸换声诈骗在全国爆发

引发大家广泛关注

甚至造成了一定恐慌

经过

国家反诈中心

研判分析发现

此类

AI换脸换声诈骗

发案占比很低

全国发生不到10起

且并非我们所想的

实时视频互动通话

犯罪分子采用的多数是

下面这种套路

???

诈骗套路

诈骗分子利用AI换脸技术,提前制作了冒充领导或熟人的视频,并不是实时的视频互动通话。

其本质就是冒充领导和熟人类诈骗的升级版。

首先诈骗分子通过非法渠道获取受害人的通讯录和社会关系等信息,使用领导或熟人的姓名和照片,包装社交账号并添加受害人为好友。

然后诈骗分子会使用通过AI换脸换声技术合成的熟人视频,通过视频通话的方式给受害人播放,骗取受害人信任。并且为了防止受害人发现破绽,视频通话的时间往往十分短暂,诈骗分子会以正在开会等理由故意挂断电话,要求转入文字聊天。

随后,诈骗分子会以有事不方便出面等理由要求受害人代为转账,以此达到诈骗目的。

POLICE

警方提醒

01

眼见不一定为实,有图也不一定就是真相

02

涉及钱财交易,要多方核实,查验真伪

03

接到自称领导熟人转账要求时,务必通过电话、视频或当面核实确认,切记不要轻易转账

来源| 江苏警方、公安部刑侦局、江苏新闻、黑龙江日报

下面这些文章也是你要的

-

上一篇

朱慧卿图/本刊

眼见不一定为实

近日,华北某地一名地方干部正为一件事犯愁。有人冒用他的名义,与他的亲朋好友大范围添加微信好友。

和我的亲戚朋友加完好友后,骗子还给他们打了视频电话。通话时间只有几秒钟,朋友们感觉声音、画面都有点儿像。这名干部说,直到许多朋友打电话询问具体情况,他才知道此事。

估计下一步就要开始骗钱了。所以,最近几天我连续发了好几条朋友圈提醒大家。这名干部说。

受访业内人士表示,只要有足够的图像、音频素材,不法分子就可以通过人工智能换脸软件、合成声音软件伪造虚拟形象,实施诈骗。只需提取最少10个字、最多32个字,就可以合成其声音。国网信息通信产业集团安全科研专家赵明明告诉记者。

一些领导干部由于工作原因出镜率相对较高,这为骗子提供了丰富的面部识别素材;在电视、广播新闻中也可以找到一些领导干部的大段同期声,这令伪造成本更低。

在一些案件中,不法分子通过AI换脸合成视频等方式,伪造与领导干部见面、合影等内容实施诈骗,增加了涉政类诈骗的欺骗性和危害性。

AI诈骗四大趋势

中国信息通信研究院相关负责人表示,当前,人工智能辅助诈骗存在四大趋势。随着人工智能技术的普及应用,不法分子实施诈骗的精准性、迷惑性、隐蔽性增强,公安、检察等政法机关办案将面临侦查破案难、电子证据调取难、认定处理难等现实困难。

——技术成本由高向低转变。腾讯安全玄武实验室负责人于旸告诉记者,随着技术发展,人工智能深度伪造深度合成已成为一种可以低成本实现的技术。

——技术应用由单一向多元转变。腾讯互联网安全专家杨建表示,实施人工智能辅助诈骗一般要满足多个要素,包括非法获取信息、构建熟人账号、换脸换声、破解手机摄像头权限等,涉及多项技术手段。

——伪造身份从模糊向具体转变。传统电信诈骗往往只能以某派出所工作人员某网站客服等模糊虚指人设实施。但在人工智能辅助诈骗中,骗子可以以具体的人物形象出现。

瞭望|警惕!“AI换脸”诈骗出现涉政苗头

一些领导干部由于工作原因出镜率相对较高,这为骗子提供了丰富的面部识别素材;在电视、广播新闻中也可以找到一些领导干部的大段同期声,这令伪造成本更低

-

下一篇

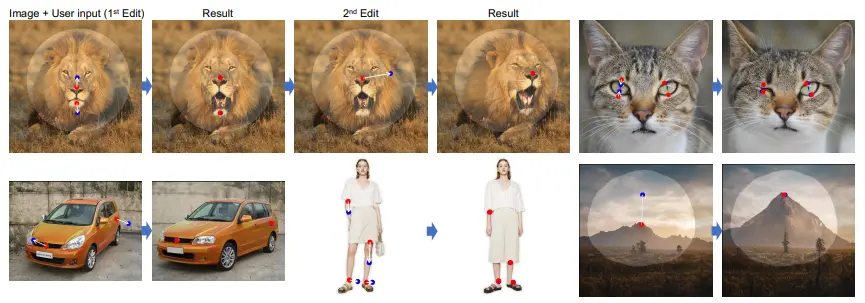

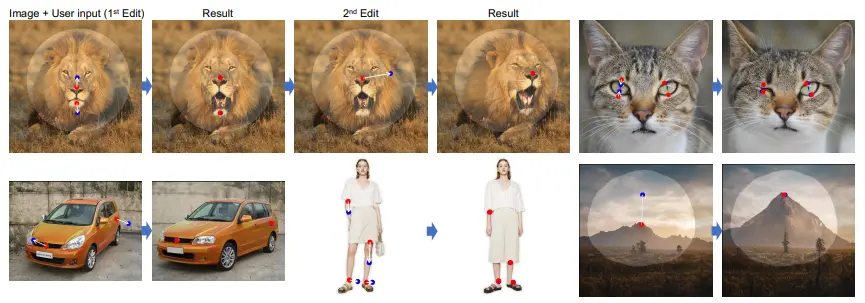

AI换脸诈骗430万;天河天元大模型发布;AI图像工具DragGAN问世

1、北京启动通用人工智能产业创新伙伴计划北京市经信局于5月19日联合北京市科委中关村管委会、北京市发改委共同启动北京市通用人工智能产业创新伙伴计划,同时发布了第