含辞未吐,声若幽兰,史上最强免费人工智能AI语音合成TTS服务微软Azure(Python3.10接入)

所谓文无第一,武无第二,云原生人工智能技术目前呈现三足鼎立的态势,微软,谷歌以及亚马逊三大巨头各擅胜场,不分伯仲,但目前微软Azure平台不仅仅只是一个PaaS平台,相比AWS,以及GAE,它应该是目前提供云计算人工智能服务最全面的一个平台,尤其是语音合成领域,论AI语音的平顺、自然以及拟真性,无平台能出其右。

本次,我们通过Python3.10版本接入Azure平台语音合成接口,打造一款本地的TTS服务(文本转语音:Text To Speech)。

准备工作

在平台上创建免费订阅服务:https://azure.microsoft.com/zh-cn/free/cognitive-services/

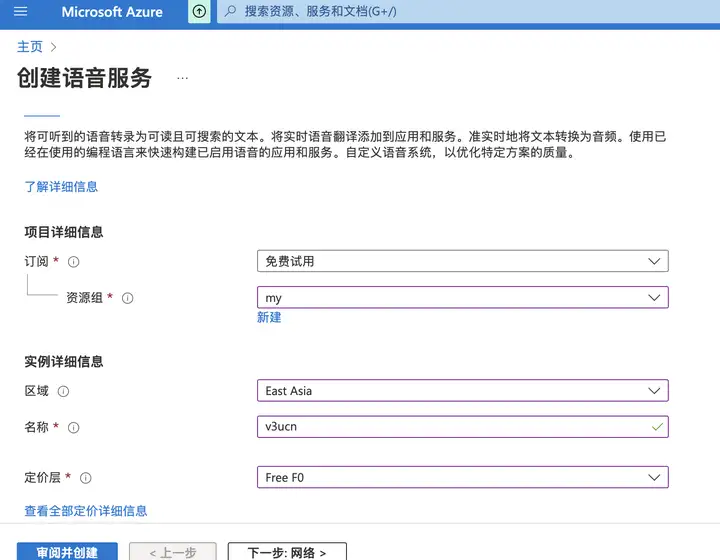

免费订阅成功后,进入资源创建环节,这里我们访问网址,创建免费的语音资源:https://portal.azure.com/create/Microsoft.CognitiveServicesSpeechServices

这里注意订阅选择免费试用,使用区域选择东亚,如果在国外可以选择国外的对应区域。

创建语音服务资源成功后,转到资源组列表,点击获取资源秘钥:

需要注意的是,任何时候都不要将秘钥进行传播,或者将秘钥写入代码并且提交版本。

这里相对稳妥的方式是将秘钥写入本地系统的环境变量中。

Windows系统使用如下命令:

setx COGNITIVE_SERVICE_KEY 您的秘钥Linux系统使用如下命令:

export COGNITIVE_SERVICE_KEY=您的秘钥Mac系统的bash终端:

编辑 ~/.bash_profile,然后添加环境变量

export COGNITIVE_SERVICE_KEY=您的秘钥添加环境变量后,请从控制台窗口运行 source ~/.bash_profile,使更改生效。

Mac系统的zsh终端:

编辑 ~/.zshrc,然后添加环境变量

export COGNITIVE_SERVICE_KEY=您的秘钥如此,前期准备工作就完成了。

本地接入

确保本地Python环境版本3.10以上,然后安装Azure平台sdk:

pip3 install azure-cognitiveservices-speech创建test.py文件:

`import azure.cognitiveservices.speech as speechsdk

import os

speech_config = speechsdk.SpeechConfig(subscription=os.environ.get(KEY), region="eastasia")``audio_config = speechsdk.audio.AudioOutputConfig(use_default_speaker=True)`这里定义语音的配置文件,通过os模块将上文环境变量中的秘钥取出使用,region就是新建语音资源时选择的地区,audio_config是选择当前计算机默认的音箱进行输出操作。

接着,根据官方文档的配置,选择一个语音机器人:https://learn.microsoft.com/zh-cn/azure/cognitive-services/speech-service/language-support?tabs=stt-ttsprebuilt-neural-voices

纯文本 wuu-CN-XiaotongNeural1(女)

wuu-CN-YunzheNeural1(男) 不支持

yue-CN 中文(粤语,简体) yue-CN 纯文本 yue-CN-XiaoMinNeural1(女)

yue-CN-YunSongNeural1(男) 不支持

zh-CN 中文(普通话,简体) zh-CN 音频 + 人工标记的脚本

纯文本

结构化文本

短语列表 zh-CN-XiaochenNeural4、5、6(女)

zh-CN-XiaohanNeural2、4、5、6(女)

zh-CN-XiaomengNeural1、2、4、5、6(女)

zh-CN-XiaomoNeural2、3、4、5、6(女)

zh-CN-XiaoqiuNeural4、5、6(女)

zh-CN-XiaoruiNeural2、4、5、6(女)

zh-CN-XiaoshuangNeural2、4、5、6、8(女)

zh-CN-XiaoxiaoNeural2、4、5、6(女)

zh-CN-XiaoxuanNeural2、3、4、5、6(女)

zh-CN-XiaoyanNeural4、5、6(女)

zh-CN-XiaoyiNeural1、2、4、5、6(女)

zh-CN-XiaoyouNeural4、5、6、8(女)

zh-CN-XiaozhenNeural1、2、4、5、6(女)

zh-CN-YunfengNeural1、2、4、5、6(男)

zh-CN-YunhaoNeural1、2、4、5、6(男)

zh-CN-YunjianNeural1、2、4、5、6(男)

zh-CN-YunxiaNeural1、2、4、5、6(男)

zh-CN-YunxiNeural2、3、4、5、6(男)

zh-CN-YunyangNeural2、4、5、6(男)

zh-CN-YunyeNeural2、3、4、5、6(男)

zh-CN-YunzeNeural1、2、3、4、5、6(男) 神经网络定制声音专业版

神经网络定制声音精简版(预览版)

跨语言语音(预览版)

zh-CN-henan 中文(中原河南普通话,中国大陆) 不支持 不支持 zh-CN-henan-YundengNeural1(男) 不支持

zh-CN-liaoning 中文(东北普通话,中国大陆) 不支持 不支持 zh-CN-liaoning-XiaobeiNeural1(女) 不支持

zh-CN-shaanxi 中文(中原陕西普通话,中国大陆) 不支持 不支持 zh-CN-shaanxi-XiaoniNeural1(女) 不支持

zh-CN-shandong 中文(冀鲁普通话,中国大陆) 不支持 不支持 zh-CN-shandong-YunxiangNeural1(男) 不支持

zh-CN-sichuan 中文(西南普通话,简体) zh-CN-sichuan 纯文本 zh-CN-sichuan-YunxiNeural1(男) 不支持

zh-HK 中文(粤语,繁体) zh-HK 纯文本 zh-HK-HiuGaaiNeural4、5、6(女)

zh-HK-HiuMaanNeural4、5、6(女)

zh-HK-WanLungNeural1、4、5、6(男) 神经网络定制声音专业版

zh-TW 中文(台湾普通话) zh-TW 纯文本 zh-TW-HsiaoChenNeural4、5、6(女)

zh-TW-HsiaoYuNeural4、5、6(女)

zh-TW-YunJheNeural4、5、6(男) 神经网络定制声音专业版单以中文语音论,可选择的范围还是相当广泛的。

继续编辑代码:

import azure.cognitiveservices.speech as speechsdk

import os

speech_config = speechsdk.SpeechConfig(subscription=os.environ.get(KEY), region="eastasia")

audio_config = speechsdk.audio.AudioOutputConfig(use_default_speaker=True)

speech_config.speech_synthesis_voice_name=zh-CN-XiaomoNeural

speech_synthesizer = speechsdk.SpeechSynthesizer(speech_config=speech_config, audio_config=audio_config)

text = "hello 大家好,这里是人工智能AI机器人在说话"

speech_synthesis_result = speech_synthesizer.speak_text_async(text).get()这里我们选择zh-CN-XiaomoNeural作为默认AI语音,并且将text文本变量中的内容通过音箱进行输出。

如果愿意,我们也可以将语音输出为实体文件进行存储:

import azure.cognitiveservices.speech as speechsdk

import os

speech_config = speechsdk.SpeechConfig(subscription=os.environ.get(KEY), region="eastasia")

audio_config = speechsdk.audio.AudioOutputConfig(use_default_speaker=True)

file_config = speechsdk.audio.AudioOutputConfig(filename="./output.wav")

speech_config.speech_synthesis_voice_name=zh-CN-XiaomoNeural

speech_synthesizer = speechsdk.SpeechSynthesizer(speech_config=speech_config, audio_config=file_config)

text = "hello 大家好,这里是人工智能AI机器人在说话"

speech_synthesis_result = speech_synthesizer.speak_text_async(text).get()这里指定file_config配置为脚本相对路径下的output.wav文件:

ls

output.wav如此,音频文件就可以被保存起来,留作以后使用了。

语音调优

默认AI语音听多了,难免会有些索然寡味之感,幸运的是,Azure平台提供了语音合成标记语言 (SSML) ,它可以改善合成语音的听感。

根据Azure官方文档:https://learn.microsoft.com/zh-cn/azure/cognitive-services/speech-service/speech-synthesis-markup

通过调整语音的角色以及样式来获取定制化的声音:

语音 样式 角色

en-GB-RyanNeural1 cheerful, chat 不支持

en-GB-SoniaNeural1 cheerful, sad 不支持

en-US-AriaNeural chat, customerservice, narration-professional, newscast-casual, newscast-formal, cheerful, empathetic, angry, sad, excited, friendly, terrified, shouting, unfriendly, whispering, hopeful 不支持

en-US-DavisNeural chat, angry, cheerful, excited, friendly, hopeful, sad, shouting, terrified, unfriendly, whispering 不支持

en-US-GuyNeural newscast, angry, cheerful, sad, excited, friendly, terrified, shouting, unfriendly, whispering, hopeful 不支持

en-US-JaneNeural angry, cheerful, excited, friendly, hopeful, sad, shouting, terrified, unfriendly, whispering 不支持

en-US-JasonNeural angry, cheerful, excited, friendly, hopeful, sad, shouting, terrified, unfriendly, whispering 不支持

en-US-JennyNeural assistant, chat, customerservice, newscast, angry, cheerful, sad, excited, friendly, terrified, shouting, unfriendly, whispering, hopeful 不支持

en-US-NancyNeural angry, cheerful, excited, friendly, hopeful, sad, shouting, terrified, unfriendly, whispering 不支持

en-US-SaraNeural angry, cheerful, excited, friendly, hopeful, sad, shouting, terrified, unfriendly, whispering 不支持

en-US-TonyNeural angry, cheerful, excited, friendly, hopeful, sad, shouting, terrified, unfriendly, whispering 不支持

es-MX-JorgeNeural1 cheerful, chat 不支持

fr-FR-DeniseNeural1 cheerful, sad 不支持

fr-FR-HenriNeural1 cheerful, sad 不支持

it-IT-IsabellaNeural1 cheerful, chat 不支持

ja-JP-NanamiNeural chat, customerservice, cheerful 不支持

pt-BR-FranciscaNeural calm 不支持

zh-CN-XiaohanNeural5 calm, fearful, cheerful, disgruntled, serious, angry, sad, gentle, affectionate, embarrassed 不支持

zh-CN-XiaomengNeural1、5 chat 不支持

zh-CN-XiaomoNeural5 embarrassed, calm, fearful, cheerful, disgruntled, serious, angry, sad, depressed, affectionate, gentle, envious YoungAdultFemale, YoungAdultMale, OlderAdultFemale, OlderAdultMale, SeniorFemale, SeniorMale, Girl, Boy

zh-CN-XiaoruiNeural5 calm, fearful, angry, sad 不支持

zh-CN-XiaoshuangNeural5 chat 不支持

zh-CN-XiaoxiaoNeural5 assistant, chat, customerservice, newscast, affectionate, angry, calm, cheerful, disgruntled, fearful, gentle, lyrical, sad, serious, poetry-reading 不支持

zh-CN-XiaoxuanNeural5 calm, fearful, cheerful, disgruntled, serious, angry, gentle, depressed YoungAdultFemale, YoungAdultMale, OlderAdultFemale, OlderAdultMale, SeniorFemale, SeniorMale, Girl, Boy

zh-CN-XiaoyiNeural1、5 angry, disgruntled, affectionate, cheerful, fearful, sad, embarrassed, serious, gentle 不支持

zh-CN-XiaozhenNeural1、5 angry, disgruntled, cheerful, fearful, sad, serious 不支持

zh-CN-YunfengNeural1、5 angry, disgruntled, cheerful, fearful, sad, serious, depressed 不支持

zh-CN-YunhaoNeural1、2、5 advertisement-upbeat 不支持

zh-CN-YunjianNeural1、3、4、5 Narration-relaxed, Sports_commentary, Sports_commentary_excited 不支持

zh-CN-YunxiaNeural1、5 calm, fearful, cheerful, angry, sad 不支持

zh-CN-YunxiNeural5 narration-relaxed, embarrassed, fearful, cheerful, disgruntled, serious, angry, sad, depressed, chat, assistant, newscast Narrator, YoungAdultMale, Boy

zh-CN-YunyangNeural5 customerservice, narration-professional, newscast-casual 不支持

zh-CN-YunyeNeural5 embarrassed, calm, fearful, cheerful, disgruntled, serious, angry, sad YoungAdultFemale, YoungAdultMale, OlderAdultFemale, OlderAdultMale, SeniorFemale, SeniorMale, Girl, Boy

zh-CN-YunzeNeural1、5 calm, fearful, cheerful, disgruntled, serious, angry, sad, depressed, documentary-narration OlderAdultMale, SeniorMale这里将语音文本改造为SSML的配置格式:

import os

import azure.cognitiveservices.speech as speechsdk

speech_config = speechsdk.SpeechConfig(subscription=os.environ.get(KEY), region="eastasia")

audio_config = speechsdk.audio.AudioOutputConfig(use_default_speaker=True)

file_config = speechsdk.audio.AudioOutputConfig(filename="./output.wav")

speech_config.speech_synthesis_voice_name=zh-CN-XiaomoNeural

speech_synthesizer = speechsdk.SpeechSynthesizer(speech_config=speech_config, audio_config=file_config)

text = "hello 大家好,这里是人工智能AI机器人在说话"

speech_synthesis_result = speech_synthesizer.speak_text_async(text).get()

text = """

hello 大家好,这里是刘悦的技术博客

大江东去,浪淘尽,千古风流人物。

故垒西边,人道是,三国周郎赤壁。

乱石穿空,惊涛拍岸,卷起千堆雪。

江山如画,一时多少豪杰。

"""

result = speech_synthesizer.speak_ssml_async(ssml=text).get()通过使用style和role标记进行定制,同时使用rate属性来提升百分之十二的语速,从而让AI语音更加连贯顺畅。注意这里使用ssml=text来声明ssml格式的文本。

结语

人工智能AI语音系统完成了人工智能在语音合成这个细分市场的落地应用,为互联网领域内许多需要配音的业务节约了成本和时间。

-

上一篇

Meta考虑放宽开源AI大模型,允许开发者商用化

Meta CEO 马克・扎克伯格希望其他公司能够自由使用 Meta 正在开发的人工智能新软件,并能从中获利。

Meta 正在研究如何将其开源大语言模型(LLM)的下一个版本用于商业用途,对于开发者和企业而言,这可能产生重大影响。Meta 此举将直接竞争谷歌和 OpenAI 销售的专有软件,同时也将有益于 Meta 自身。Meta 的发言人拒绝对此置评,而相关市场行情的影响有待观察。

微软Bing升级识图功能

微软 Bing 的界面上出现了上传图片的选项,根据用户上传的图片,Bing 就能识图回答问题。

识图功能在 GPT-4 发布时就已提及,如今微软 Bing 似乎抢先 ChatGPT 一步发布识图功能。

中科院:自主研制新一代人工智能大模型问世

中国科学院自动化研究所今天上午在上海发布了该所研制的新一代人工智能大模型——紫东太初2.0。

全新大模型相比第一代着力提升了决策与判断能力,实现了从感知、认知到决策的跨越,未来将在医疗、交通、工业生产等领域发挥更大作用。作为我国首个存储千亿参数的图文音三模态大模型,第一代紫东太初人工智能大模型在2021年问世时实现了无标识的图像、文字、语音的识别能力,这次发布的新一代大模型则升级融入了视频、传感信号、3D点云等识别能力,突破了多模态分组认知编码、解码,全模态认知等关键技术,提升了系统的决策和判断能力,打通了系统识别能力从感知、认知到决策的通路,从而拓展出更为广泛的应用场景。

目前,紫东太初大模型已经在神经外科手术导航、短视频内容审核、医疗多模态鉴别诊断、交通违规图像研读等多领域应用。

Meta首席人工智能科学家:ChatGPT背后的生成式人工智能技术拥有太多的局限性

ChatGPT首次应用于车载系统,梅赛德斯-奔驰与微软合作测试其AI语音助手

梅赛德斯-奔驰和微软宣布正在合作测试车载ChatGPT人工智能,在美国有超过90万辆汽车可以使用。

-

下一篇

ai图用起来好用吗怎么做AI配音

AI图像生成技术和AI语音合成技术在近年来快速发展,成为了许多领域中不可或缺的工具。AI图像生成技术可以生成逼真的图像,成为了设计、娱乐、安防等领域的常用工具,